alarmas en robótica neuroetológica

alarmas en robótica neuroetológica

Definición: La voz neuroetología es una derivación de "etología" (Lorenz, 1981), que es el estudio de la conducta, en sus ambientes naturales, de animales viviendo su existencia diaria. Se denomina entonces neuroetología (Camhi, 1984) al estudio de los mecanismos neuronales subyacentes asociados a esa conducta natural. Se define neuroetología computacional (Beer, 1991) al modelado por computadora del control neural de la conducta de animales provistos de sistemas nerviosos, empezando por los más simples. Se puede denominar neuroetología robótica (Beer, 1992) a la rama del control e instrumentación dedicada al diseńo de "gerentes artificiales" o gestores artificiales con capacidad de acción autónoma y flexible, orientada a la aplicación de las enseńanzas de la neuroetología computacional.

Daniel Dennett (1978) - en su texto Why not the whole iguana - recomienda encarar el modelado - ya no de sub-sub-sistemas de la vía lógico - simbólica para acceder al ideal de la inteligencia artificia - sino de creaturas cognitivas completas, que podrían ser iguanas marcianas con tres ruedas. Luego, en 1987, lo piensa mejor y predica apartarse de la profundización en microcompetencias humanas como el juego del ajedrez para encarar la macrocompetencia de animales simples (ya no extrańas iguanas extraterrestres), macrocompetencia que busca verlos como totalidad generadora de conductas.

Mientras tanto Hopfield (1982, 1984) presenta sus circuitos neurales basados en integradores operacionales como modelos de neuronas, integradores cuya entrada posee una descarga a tierra conectada en paralelo a través de una batería y una conductancia, con las cuales este autor da cuenta de las propiedades de las membranas neuronales.

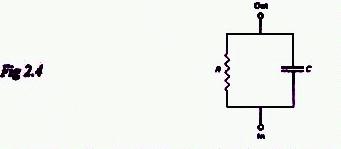

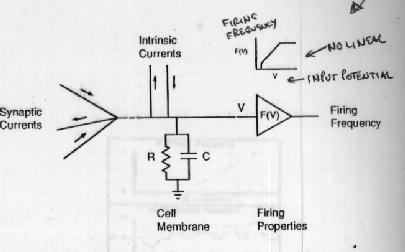

- En la Fig. 2.4 se representa el circuito eléctrico que sirve de correlato a la membrana neuronal externa - se trata de un circuíto conductancia R - condensador o batería C en paralelo. La idea es de Hopfield.

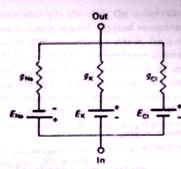

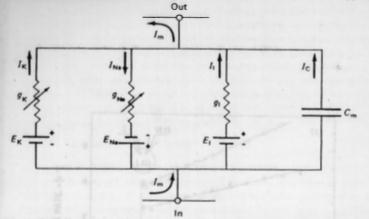

- En la Fig 2.3 Kandel y Schwartz(1985) simulan el potencial de descanso mediante un circuíto especial. Este esquema descarta muchos aniones y cationes y se concentra en el papel del ión sodio Na

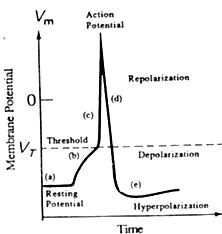

Como resultado de los flujos difusivos durante el estado de reposo la neurona está cargada negativamente. Al salir del estado de reposo, algunas neuronas hacen una excursión que las vuelve transitoriamente más negativas, con efectos inhibitorios. Esta es la acción inhibidora que se marca con un círculo en los diagramas. Otras posibilidades diferentes son las de hacer una excursión que las vuelve muy positivas, lo cual es típico de las neuronas excitatrices. La acción excitadora se marca con un triángulo. Los cambios en el potencial de la membrana se indican en la Fig 2.5.

Fig.2.5.

- Fig 2.5 - Durante un típico disparo neuronal, los cambios en el potencial de membrana en las diferentes etapas, permiten diferenciar (a) una zona de potencial de descanso, (b) una zona de despolarización resultante de la aplicación de una corriente externa, (c) una zona que supera al umbral VTen que se produce el disparo y el cambio deviene explosivo. El máximo marca el potencial de acción del disparo. El proceso se reversa bruscamente y decae en (d), mientras sigue efimeramente en la zona de repolarización, con tendencia a la despolarizaciónl y avanza hacia la zona de hiperpolarización (e). menor aún que el mismo potencial de descanso, asíntota a la cual tiende suavemente, (a).

Fig. 2.6

- Fig 2.6 - Un diagrama más completo es el que incorpora una batería como el que proponía Hopfield, reemplazando al ión cloro por una corriente más generalizada que abarca todas las influencias eléctricas activas que surgen en la membrana, que no sean ni el flujo del ión sodio ni el del ión potasio, ambos anotados como conductancias variables.

Fig. 3.2

- Fig 3.2 - Simplificando por analogía con Hopfield (Fig 2.4) se obtiene este diseńo, donde la gran novedad es la de establecer nuevas corrientes intrínsecas de entrada o de salida que pueden excitar o inhibir y que simulan el saldo no contabilizado por la toma a tierra RC de Hopfield. Esas corrientes intrínsecas no siempre son constantes y su modulación tiene varios resultados diferentes

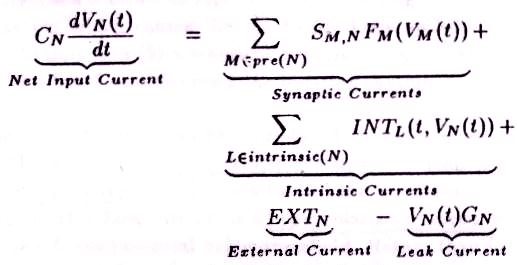

MODELO MATEMATICO

El valor del potencial VN (t) de cada neurona N tiene la siguiente forma general

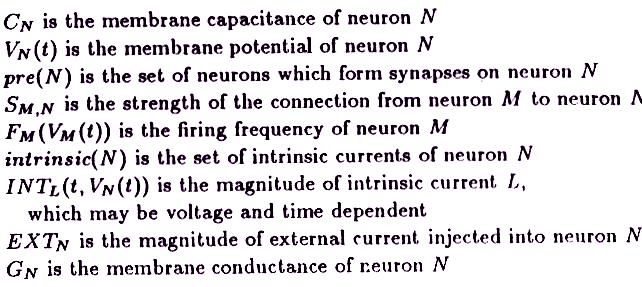

con la siguiente nomenclatura (en inglés):

y conocido dicho valor se lo transforma (mediante el integrador operacional) en frecuencia de disparo, segun el modelo no lineal que aparece en el ángulo superior derecho de la fig. 3.2.

Una red es un conjunto que posibilita posibles cálculos simultáneos con estas ecuaciones y gráficos del tipo de éstos del ángulo superior derecho. Una ecuación diferencial es una neurona de la fig. 3.2 y de los diversos mapas de redes neurales que aparecen a continuación como Figs I, II y II..

Las ecuaciones del modelo matemático se resuelven integrándolas por el método de Euler con pasos de aproximadamente 5 milisegundos.Cada cuatro (en general N) pasos se actualiza el modelo físico y gráfico del insecto, modelo que aparece en pantalla, situado en un ambiente que se puede alterar a voluntad, siempre en dos dimensiones tanto para el ambiente como para el insecto.

ALGUNAS SUBRREDES COMPORTAMENTALES

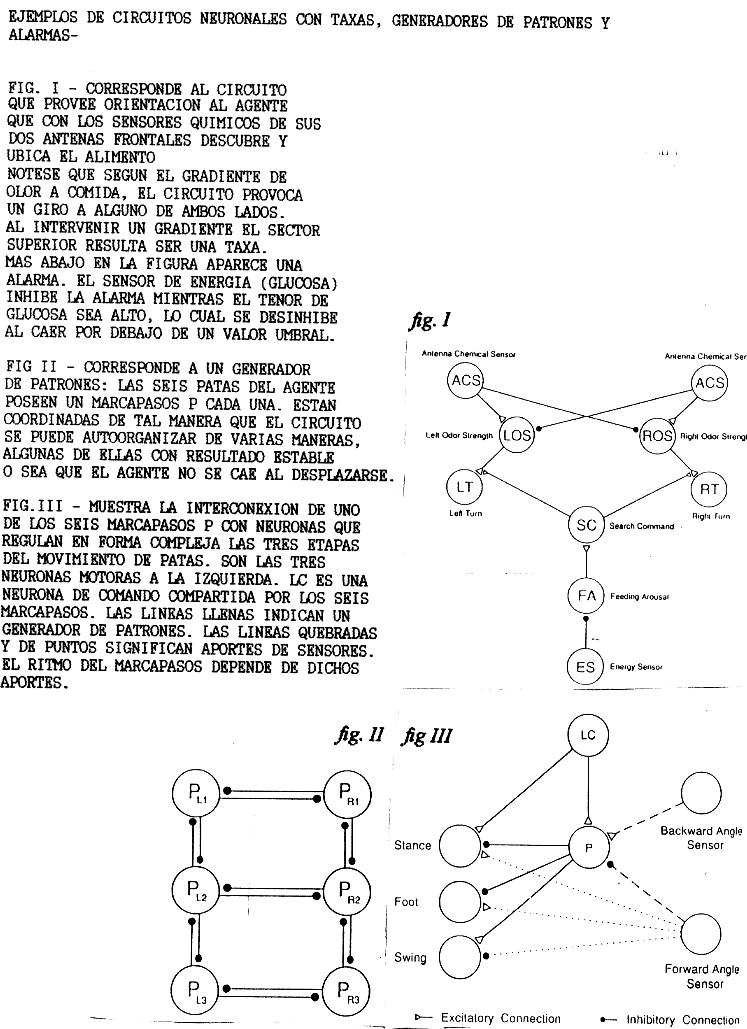

Simplemente para indicar temas en los que Randall Beer resultó inspirador para nuestro trabajo, a continuación aparece un ejemplo (Fig I) de una taxa (reconocer por el gradiente la presencia de alimento) y otro (Figs II y III) de un generador de patrones de acción fija (permitir el andar de las seis patas del insecto con seis marcapasos).

EJEMPLOS DE CIRCUITOS NEURONALES CON TAXAS, GENERADORES DE PATRONES Y QUE IMPLICAN ALARMAS

ALARMAS

Daniel Dennett en su libro Conciousness Explained retoma un tema sobre el cual había insistido fuertemente en publicaciones previas. El animal con cerebro en evolución consigue ir armando sistemas de alarma que lo mantienen innatamente prevenido de riesgos y depredadores, así como de no dejar de aprovechar innatamente circunstancias favorables. Esas alarmas son asimismo la base de todo sistema neo-cortical superior, arrastrando entonces la misma configuración y recursos previos de alarmas superadas por las condiciones cambiantes del ecosistema al cual el animal se había adaptado. Si se parte de la regla biológica de que todo sistema nervioso ya superado por cambios en el ambiente, es evolutivamente aprovechado por una nueva configuración neuronal para enfrentar nuevos problemas del ambiente, es válido pensar lo mismo con respecto a las alarmas neuroetológicas.

Nuestro trabajo se basa en hipotetizar que los sistemas evolutivos de alarmas neuroetológicas tienen algunos patrones en común que permiten encontrar explicaciones generales para los sistemas neuroetológicos asociados con las funciones neo-corticales superiores. La teoría de las alarmas construída tendría claras consecuencias sobre la fabricación de sistemas de automatización y control industriales, con atributos del tipo del que se pretendería de un gestor o "gerente artificial", esto es, con suficiente autonomía frente a situaciones inesperadas.

Como consecuencia del estudio previamente explicado, podemos formular respuestas, bastante significativas pero tentativas, a una serie de importantes preguntas que buscan dejar en claro algunas conclusiones generalizantes.

1) żQué similitud tienen los sistemas nerviosos de diferentes animales, con especial referencia a los sistemas de alarma?

- Alarmas por la detección de alimento y de agua

- Alarma de saciedad

- Alarmas asociadas al desplazamiento hacia el alimento.

- Alarma para enfrentar o huir o transformar enfrentamiento en huida y viceversa.

- Alarma por dejar de aprovechar una opción de reproducción (actitud masculina) o de dejar de verificar aptitud del cortejante (actitud femenina).

- Circuitos de alarma similares en reflejos, taxas y generadores de patrones de conducta.

- "Ciclos decisionales neuroetológicos".

Respuesta tentativa: Todos los sistemas nerviosos de animales poseen:

2) żQué concepto neuroetológico es más fundamental y general que la inteligencia?

Respuesta tentativa: El de flexibilidad que conduce a la autonomía (independencia de un reglamento externo) en los seres vivientes, sobre todo en los provistos de sistemas nerviosos.

3) żCuál es la relación entre la inteligencia y las alarmas evolucionadas?

Respuesta tentativa: La inteligencia (excluyendo de ella el aprendizaje y la memoria) es una conducta adaptiva. Ella es respuesta flexible a las alarmas resultantes de condiciones complejas en ambientes complejos.

4) żCuáles son los mecanismos neuroetológicos que respaldan una conducta inteligente?

Respuesta tentativa: Son mecanismos que le permiten al agente la caracterización borrosa o nítida de su objetivo en cada momento pero no incluyen mecanismos para caracterizar la trayectoria intencional previa o posterior. Incluyen alarmas de tipo ético y dentro de la ley aceptada. El plan general cumple un papel mínimo y la ejecución del objetivo inmediato cumple un papel máximo durante la actividad del agente.

5) żEs necesaria o nó la apelación a las representaciones internas de los objetivos generales para la actividad de un agente inteligente?

Respuesta tentativa: Continuando la respuesta previa, la acción del agente está situada, o sea que resulta contingente con la situación actual que se está desenvolviendo. No necesita haber - y quizás no hay - una prescripción a priori de cómo se va a desarrollar la interacción con el mundo real. A posteriori las funciones intelectuales superiores omiten - en general - las motivaciones cruciales, rescatan las motivaciones y acciones de cada momento y racionalizan o disfrazan toda la acción en una síntesis con la cual aparece que hubiese habido un plan a satisfacer. El pensamiento primitivo ignora en general esta síntesis, que es más bien característica del pensamiento culto, entrenado en sacar conclusiones y presentar síntesis. El pensamiento culto va torciendo al pensamiento primitivo de manera que se unifique la PLANIFICACION con la EJECUCION.

6) Desde un comienzo, żcómo se logran las estructuras adecuadas para conseguir una dinámica de mecanismos internos?

Respuesta tentativa: A esta pregunta corresponde una contestación histórico-evolucionaria, que rescata de estadios primitivos estructuras que por azar resultaron adecuadas y sobreimpone a ellas otras nuevas estructuras tentativas, siempre basadas en circuitos que las contingencias del ambiente hicieron quedar en desuso.

7) żCómo se consigue hacer aparecer una conducta orientada hacia objetivos?

Respuesta tentativa: A través de mecanismos que no incluyen la representación interna de la situación del agente inteligente, a la manera del cerebro-B de Marvin Minsky que no participa directamente de las percepciones del cerebro-A del mismo autor. La conducta orientada hacia objetivos se deriva más bien de algunos estados o dinámicas internas del sistema nervioso del agente que modulan las interacciones entre las diferentes conductas (A y B) posibilitadas por las subrredes neurales (A y B) existentes.

8) En el caso de un agente computacional en una computadora, żcómo se logra reproducir en él una conducta inteligente?

Respuesta tentativa: Empezando por seres simples provistos de sistemas nerviosos esquemáticos, tales como los buscados en estudios como el que aquí se insinúa, esto es, con robots bidimensionales imitando invertebrados hexapódicos (o sea insectos con 6 patas). Los seres humanos, con todas sus posibilidades y restricciones conductuales (éticas, etc.), son, en pocas palabras, demasiado complejos para imitar el diseńo de sus mecanismos internos.

9) żCómo una descripción simbólica externa al agente, del tipo IF... THEN..., se correlaciona con una conducta interna de una red neural que genera la conducta del agente?

Respuesta tentativa: En algunos casos es muy problemático, como en el caso de la autoorganización del andar o aire de un desplazamiento del agente, que es función de la velocidad, de la posición inicial de las patas, de los aportes de sensores (ver Fig III), etc., Estos resultan ser datos básicos para que los marcapasos se autoorganicen sin mucha posibilidad de acierto por parte de una regla lógico- simbólica, que no puede contemplar todos los casos posibles.

10) żCuáles son los mecanismos internos por los cuales aparecen transiciones de conducta gatilladas por condiciones iniciales internas al agente?

Respuesta tentativa: No se pueden formular reglas generales. Cada neurona exhibe sus propias dinámicas. Existen efectos de avanacción y de retroalimentación. Aparecen sinapsis modificatorias, en forma brusca, de conductas. Hay hormonas y neurohumores bioquímicos.

11) żCómo se implementan las bifurcaciones en una decisión hacia una posibilidad u otra?

Respuesta tentativa: Sin una neurona de comando; en cambio, con aportes no-jerárquicos de diferentes subrredes

12)żQué aplicaciones tiene?

reflejos, taxas, generadores de patrones de conductas de acción fija

la vera efigie de Periplaneta computatrix con 78 "neuronas", o sea, los círculos coloreados

simulación electrónica de cada una de las "neuronas" de Periplaneta computatrix

Respuesta tentativa: Directas, en el diseńo de robots o de sistemas automáticos con esbozos de capacidad gerencial autónoma, sujeta a restricciones o alarmas

BIBLIOGRAFIA

Simon H - Las Ciencias de lo Artificial

Tank DW, Hopfield JJ - Investigación y Ciencia (1984)

Hopfield JJ, Tank DW - Biological Cybernetics, 52, 141-152

Dennett D - Conciousness Explained

Beer R - Intelligence as Adaptive Behavior: An experiment in Computational Neuroethology - Academic Press (1990)

Beer R, McKenna Th - Invertebrate Neuroethology and Robotics - Academic Press (1992)

Williams P, Williams G - Programa Neural Systems (NS), en Shareware, Rt 1, Box 302, Gravel Switch, KY 40328, con explicaciones para su ejecución.

Leggett DJ - Instrumental Simplex Optimization - Journal of Chemical Education - 60,9,1983, p. 707

Crick F, Ansanuma C-en Rumelhart y McClelland (eds) Parallel Distributed Processes, Vol 1, (1986) MIT Press, p. 333

Lorenz KZ - The Foundations of Ethology - Simon & Shuster (1981)

Camhi JM - Neuroethology. Sinauer Associates (1984)

Becke CH von der - Optimización de Suprasistemas, UTN, (1989)

Becke CH von der, Barral R y Motto A- Neuronal Processing Systems - I. Explorations on Cortical Processing with Non Hierarchical Structures, Medyfinol (1994)

Becke CH von der y Contou Carrere JE -Control por inteligencia artificial Alimentación latinoamericana (1988)

29.jun.1999

Pulsar tecla de vuelta

Temas de investigación de Carlos von der Becke y colaboradores, en el Glosario del primero de los nombrados.